Por que o Cronômetro é seu Pior Inimigo: A Verdade Oculta sobre a Eficiência de Software

Desenvolvedores de software, frequentemente são confrontados com a frustração de um utilizador diante de um sistema que não responde à altura de suas necessidades. No entanto, a eficiência de um algoritmo não é apenas um detalhe técnico ou um “capricho” de implementação; é a base sobre a qual construímos experiências fluidas e sistemas escaláveis. Quando ignoramos o custo computacional, falhamos em nossa responsabilidade profissional.

“Nada é mais penoso ao utilizador do que trabalhar com programas com elevados tempos de resposta ou que utilizam muita memória (com repercussões indirectas no tempo de resposta).”

Lição 1: Por que medir o tempo em segundos é um erro?

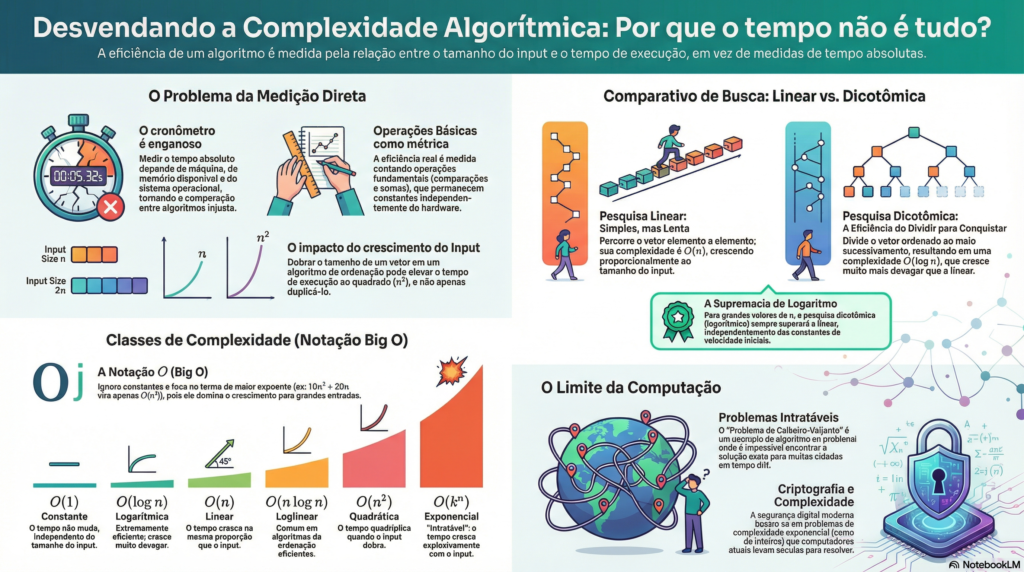

A forma mais imediata e instintiva de medir a eficiência é usar um cronômetro para marcar o tempo absoluto de execução. Contudo, essa abordagem é tecnicamente subjetiva e pouco útil para uma análise rigorosa. Os valores obtidos dependem de variáveis voláteis: o hardware da máquina, a carga do sistema operacional, a memória disponível e até a configuração do ambiente.

Para obtermos uma métrica universal, devemos focar no esforço computacional. Isso significa contar a quantidade de operações básicas efetuadas (comparações, somas, multiplicações, acessos à memória). Se designarmos a soma dos tempos dessas operações simples como uma constante k, podemos analisar o algoritmo de forma independente da máquina. O tempo absoluto é curto; a contagem de operações é a verdade constante da engenharia.

Lição 2: O mito da proporção direta (A armadilha da escala)

Um erro comum entre programadores iniciantes é assumir que o tempo de execução de um algoritmo é sempre diretamente proporcional ao tamanho do seu input. Se um vetor de 10 elementos é ordenado instantaneamente, supõe-se que 1000 elementos não seriam um problema.

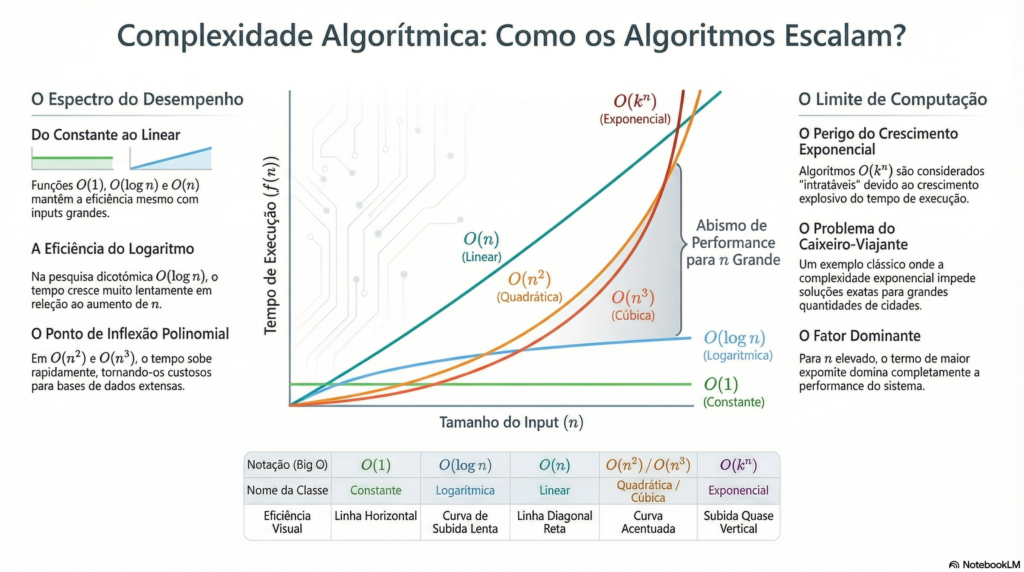

A realidade é que o crescimento raramente é linear. Em muitos algoritmos de ordenação, duplicar o tamanho do vetor não significa duplicar o tempo de resposta, mas sim elevá-lo ao quadrado (n^2). A “ideia-chave” da complexidade reside aqui: o que importa não é o tempo absoluto, mas a relação entre a dimensão do input (n) e o esforço necessário. Assim, definimos a complexidade como uma função f(n), onde o foco principal é o crescimento assimptótico — ou seja, como essa função se comporta à medida que n cresce para valores massivos.

Lição 3: Pesquisa Linear vs. Dicotômica – A estratégia vence a força bruta

Para ilustrar o impacto da escolha algorítmica, consideremos a pesquisa de um elemento em um vetor ordenado de dimensão n:

- Pesquisa Linear: Percorre o vetor elemento a elemento. No pior caso, executamos n operações. Se considerarmos a interrupção ao encontrar o elemento, temos, em média, f(n)=k . n / 2. É uma abordagem baseada em força bruta, com complexidade O(n).

- Pesquisa Dicotômica: Utiliza a estratégia de divisão sucessiva. Em cada passo, o vetor é dividido ao meio. Para entender matematicamente, pensemos ao contrário: quantas vezes precisamos duplicar um vetor de tamanho 1 para chegar a n? Ao fim de i duplicações, temos 2i=n, o que nos dá i=log2n.

Portanto, a complexidade da pesquisa dicotômica é f(n)=klog2n. Embora o valor da constante k possa variar entre os algoritmos, a função logarítmica cresce tão mais lentamente que a linear que, para grandes valores de n, a inteligência estratégica da pesquisa dicotômica sempre superará qualquer tentativa de compensação via hardware ou otimização de constantes.

Lição 4: Decifrando a Notação “Big O”

A Notação O é a ferramenta que utilizamos para classificar os algoritmos em “classes de complexidade”. Na análise teórica, desprezamos as constantes multiplicativas e os termos de menor ordem, pois eles perdem peso conforme o input escala.

Por exemplo, em um polinómio como f(n)=10+30+20n+70, dizemos que a complexidade é da ordem do termo de maior expoente, ou seja, O(). Esse termo dominante é o que dita o comportamento real do sistema em produção.

Abaixo, apresento a hierarquia das classes de complexidade mais comuns, da maior para a menor eficiência:

- O(1): Constante (independente do tamanho do input).

- O(logn): Logarítmica (extremamente eficiente para grandes volumes).

- O(n): Linear (o esforço cresce junto com o input).

- O(nb log n): Loglinear.

- O(n2): Quadrática.

- O(n3): Cúbica.

- O(nk),k>1: Polinomial.

- O(kn): Exponencial (o crescimento explosivo que torna o software inviável).

Debate sobre o Big-O:

Entre na conversa, deixe seu comentário.

Lição 5: A Fronteira do Impossível (Algoritmos Exponenciais)

Existem problemas cujos algoritmos conhecidos possuem complexidade exponencial (O(kn)), sendo classificados como “intratáveis”. O tempo de execução desses sistemas cresce tão rapidamente que eles se tornam inúteis para valores de n relativamente pequenos.

- Problema do Caixeiro-Viajante: Determinar o percurso mais curto passando por várias cidades. Dada a complexidade, recorremos a soluções aproximadas, pois o cálculo exato é inviável acima de um certo número de cidades.

- Fatorização de Números Inteiros: Aqui reside uma ironia fascinante. A ineficiência computacional é o que garante a nossa segurança digital. Os sistemas de criptografia modernos dependem do fato de que fatorar números inteiros massivos exige um esforço exponencial, tornando virtualmente impossível a quebra de códigos em tempo útil.

Conclusão: O Próximo Passo na sua Jornada de Otimização

Otimizar software não é um exercício de “micro-otimização” de código, mas uma escolha consciente de funções de crescimento. Quando compreendemos que a estratégia algorítmica e a classe de complexidade são os únicos fatores que sobrevivem à escala, deixamos de ser meros codificadores e passamos a ser engenheiros.

Na próxima vez que você escrever uma linha de código, você estará pensando em quanto tempo ela demora agora, ou em como ela se comportará quando seus dados crescerem mil vezes?

Inforgráfico sobre Complexidade Algorítmica:

Se tiver interesse em aprender Scrum, compre o Livro ou faça o curso Scrum Path+: Seu Caminho para a Agilidade através dos links abaixo:

Se quiser se aprofundar no Scrum, compre o livro Scrum Path+ : Seu caminho para agilidade, ou faça o curso Completo de Scrum. Escolha através dos botões abaixo:

Relacionados

Análise da Complexidade dos Dados

O que são Algoritmos?

Algoritmos – Notação Assintótica

Parceiros:

#Engenharia #Software #Algorítmo #Informática